La tecnología revolucionaria de las herramientas GenAI, como ChatGPT, ha traído riesgos significativos para los datos confidenciales de las organizaciones. Pero, ¿qué sabemos realmente sobre este riesgo? Una nueva investigación realizada por la empresa de seguridad de navegadores LayerX arroja luz sobre el alcance y la naturaleza de estos riesgos. El informe titulado «Revelación del verdadero riesgo de exposición de datos de GenAI» proporciona información crucial para las partes interesadas en la protección de datos y les permite tomar medidas proactivas.

Los números detrás del riesgo de ChatGPT

Al analizar el uso de ChatGPT y otras aplicaciones de IA generativa entre 10 000 empleados, el informe ha identificado áreas clave de preocupación. Un hallazgo alarmante revela que el 6% de los empleados han pegado datos confidenciales en GenAI, y el 4% se involucra en este comportamiento de riesgo semanalmente. Esta acción recurrente plantea una grave amenaza de exfiltración de datos para las organizaciones.

El informe aborda preguntas vitales de evaluación de riesgos, incluido el alcance real del uso de GenAI en la fuerza laboral de la empresa, la proporción relativa de acciones de «pegar» dentro de este uso, la cantidad de empleados que pegan datos confidenciales en GenAI y su frecuencia, los departamentos que utilizan GenAI más. y los tipos de datos confidenciales que es más probable que queden expuestos al pegarlos.

El uso y la exposición de datos están en aumento

Un descubrimiento sorprendente es un aumento del 44 % en el uso de GenAI solo en los últimos tres meses. A pesar de este crecimiento, solo un promedio del 19 % de los empleados de una organización utilizan actualmente las herramientas GenAI. Sin embargo, los riesgos asociados con el uso de GenAI siguen siendo significativos, incluso en su nivel actual de adopción.

La investigación también destaca la prevalencia de la exposición de datos confidenciales. De los empleados que usan GenAI, el 15 % se dedica a pegar datos, el 4 % lo hace semanalmente y el 0,7 % varias veces a la semana. Este comportamiento recurrente subraya la necesidad urgente de medidas sólidas de protección de datos para evitar la fuga de datos.

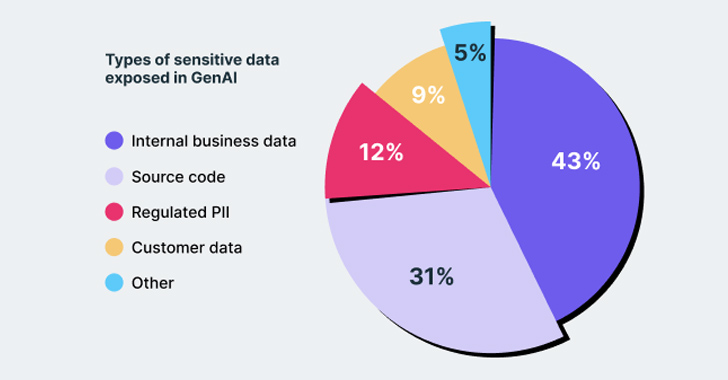

El código fuente, la información comercial interna y la información de identificación personal (PII) son los principales tipos de datos confidenciales pegados. Estos datos fueron copiados principalmente por usuarios de los departamentos de I+D, Ventas y Marketing y Finanzas.

Cómo aprovechar el informe en su organización

Las partes interesadas en la protección de datos pueden aprovechar los conocimientos proporcionados por el informe para crear planes efectivos de protección de datos de GenAI. En la era de GenAI, es crucial evaluar la visibilidad de los patrones de uso de GenAI dentro de una organización y garantizar que los productos existentes puedan proporcionar la información y la protección necesarias. De lo contrario, las partes interesadas deberían considerar la adopción de una solución que ofrezca monitoreo continuo, análisis de riesgos y control en tiempo real en cada evento dentro de una sesión de navegación.

Fuente y redacción: thehackernews.com